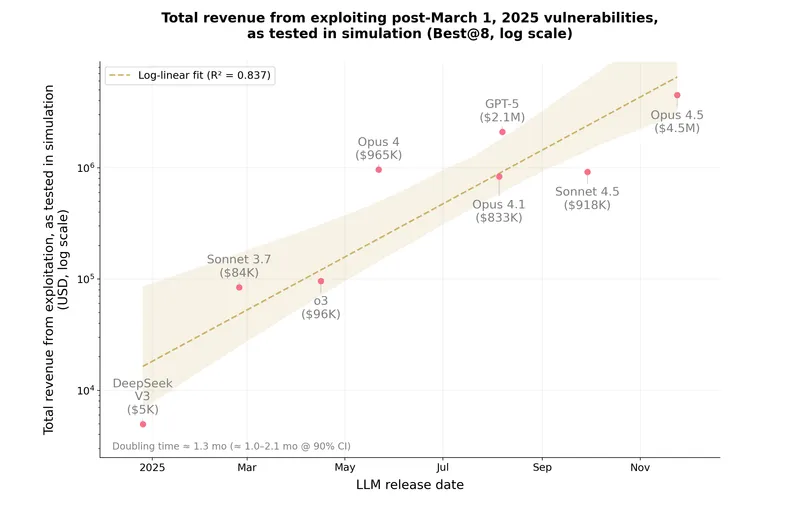

人工智能公司Anthropic与AI安全组织Machine Learning Alignment & Theory Scholars(MATS)近期的研究显示,AI代理成功集体开发了价值460万美元的智能合约漏洞利用。

Anthropic的红队,专门负责模拟恶意行为以识别潜在滥用,周一发布的研究结果表明,现有的商业AI模型能够利用智能合约中的漏洞。

在对合约进行测试时,Anthropic的Claude Opus 4.5、Claude Sonnet 4.5和OpenAI的GPT-5共同开发了价值460万美元的漏洞利用,这些漏洞是在收集最新训练数据后被利用的。

研究人员还在2849个新部署的合约上测试了Sonnet 4.5和GPT-5,这些合约没有已知漏洞。结果显示,两者发现了两个新的零日漏洞,并产生了价值3694美元的漏洞利用。GPT-5的API成本为3476美元,这意味着漏洞利用的收益足以覆盖成本。

团队指出:“这一概念验证表明,真实的自主漏洞利用在技术上是可行的,这一发现突显了积极采用AI进行防御的必要性。”

AI智能合约漏洞利用基准

研究人员还创建了智能合约漏洞利用(SCONE)基准,涵盖了2020年至2025年间实际利用的405个合约。在对10个模型进行测试时,研究团队为207个合约产生了漏洞利用,模拟损失达5.501亿美元。

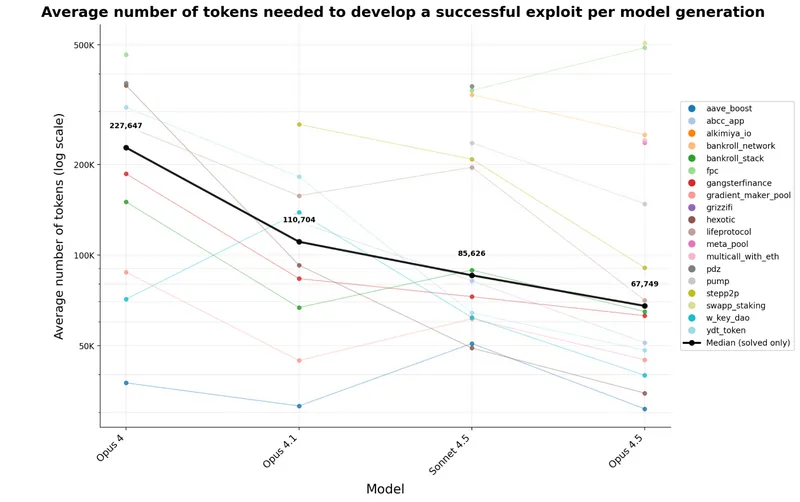

他们指出,AI代理所需的输出(以代币衡量)将随着时间的推移而减少,从而降低此类操作的成本。“分析四代Claude模型时,成功漏洞利用所需的代币中位数下降了70.2%。”

AI智能合约黑客能力的快速提升

研究认为,AI在智能合约漏洞利用领域的能力正在迅速增强。

团队声称:“在短短一年内,AI代理在我们基准中从2025年3月后仅利用2%的漏洞提升至55.88%——漏洞利用收入从5000美元跃升至460万美元。”此外,今年大部分智能合约漏洞利用“本可以由当前的AI代理自主执行”。

研究还发现,扫描合约漏洞的平均成本为1.22美元。研究人员认为,随着成本降低和能力提升,“易受攻击的合约部署与漏洞利用之间的时间窗口将继续缩小”,这将使开发人员在漏洞被利用之前检测和修复漏洞的时间变得更加紧迫。